deeplearning-repo-1/README.md at main · addinedu-amr/deeplearning-repo-1 (github.com)

GitHub - addinedu-amr/deeplearning-repo-1

Contribute to addinedu-amr/deeplearning-repo-1 development by creating an account on GitHub.

github.com

💪까꿍 PT💪

🏃개요🏃

- 운동을 해야한다고 말만하고, 안하는 사람들이 있다. 그 이유는 운동을 하는 방법을 모르기 때문이라 생각한다. 그러니 딥러닝을 통해 자세를 교정해주고, 서로 양방향 소통이 가능한 프로그램을 제작하고자 한다.

🏃시연영상 및 발표자료🏃

시연영상

https://www.youtube.com/watch?v=VtHZZ8RGzP0&t=18s

발표자료

deeplearning-repo-1/발표자료.pdf at main · addinedu-amr/deeplearning-repo-1 (github.com)

GitHub - addinedu-amr/deeplearning-repo-1

Contribute to addinedu-amr/deeplearning-repo-1 development by creating an account on GitHub.

github.com

🏃팀원 및 역할 분배🏃

◾ C (Project Management Office)

- 프로젝트 기획 및 설계

- 데이터 수집(운동의 정확한 자세 정의 및 측정)

- media pipe pose estimation 알고리즘 설계

◾ BrainKimDu(Project manager)

- 프로젝트 설계 (시간분배, 일정)

- 프로젝트 기록 및 설계도 작성

- media pipe pose estimation 알고리즘 설계

◾ P (system architecture engineer)

- 프로젝트 메니징(설계, 구체화 방향성 제시)

- 팀원 어드바이스

- media pipe

- 데이터 수집(모션 캡처 및 음성녹음)

◾ian5757 (NLT Project Leader)

- 자연어처리 (양방향 소통)

- nltk

- 음성 API (마이크로 소프트, 구글) 를 활용한 인식

- 데이터 수집(모션 캡처 및 음성녹음)

◾94sony (NLT, DB Project Leader / Data Analyst)

- 자연어처리 (양방향 소통

- nltk

- 음성 API (마이크로 소프트, 구글) 를 활용한 인식

- 데이터 수집(모션 캡처 및 음성녹음)

- 목소리의 주인공

🏃설계🏃

🔨 앱 UI 설계 🔨

🔨 엑티브 다이어그램 설계 🔨

🔨 APP 설계 🔨

- 메인화면

- 회원가입

- 운동기록

🏃구현🏃

⚾ pose estimation ⚾

- mediapipe를 사용하여, 각 관절의 좌표값을 읽어들임

구현되어 있는 운동

- 스쿼트

- 팔굽혀펴기

- 런지

- 플랭크

데이터 출처

- 정방향 모션 캡처 (준비자세, 운동자세, 틀린자세)

모델 구현

- pose estimation (DL)

- Descision Tree (ML)

: 🏀 자연어처리 🏀

머신러닝을 통한 네 VS 아니요 음성인식 구현

- 아날로그 신호인 음성신호를 분석하기 위해서 디지털 신호로 변환해주어야 한다.

- 음성신호는 타임도메인의 연속적인 데이터. 타임도메인에서 주파수 데이터를 얻는 것이 FFT. 음성은 다양한 음성이 합쳐져서 시간 영역 전체를 FFT를 하면 원하는 결과를 얻지 못 할 수 있다. 그래서 시간 영역을 짧게 쪼개어서 각 영역마다 FFT를 수행하는 개념인 STFT하면 타임도메인의 스펙트럼이 나온다,

- 사람은 저주파 대역에 더 민감하다. 그래서 스펙트럼에 mel scale을 기반한 filter bank인 mel filter bank를 적용시켜서 mel spectrum을 얻을 수 있다. 이를 다시 x축을 time domain으로, megnitude 를 dB로 변환해서 그려주면 mel spectrogram이 나온다.

- mel spectrum에 cepstral 분석 방식을 거치면 학습에 사용하기 좋은 mfcc가 나온다 *MFCC는 오디오 신호에서 추출할 수 있는 feature로, 소리의 고유한 특징을 나타내는 수치

결과물

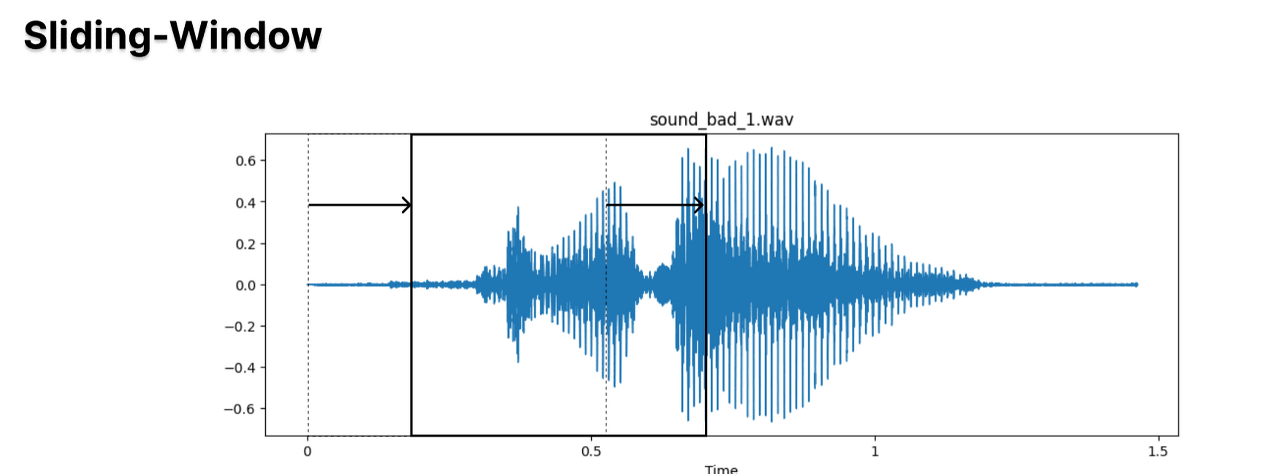

- Sliding - Window 방식을 통해 네, 아니요 판별

📀 데이터베이스 📀

'ㅇ 프로젝트 > TEAM_운동보조프로그램' 카테고리의 다른 글

| 딥러닝 프로젝트 개요서 (0) | 2023.02.07 |

|---|---|

| 7. 데이터베이스 구현하기 및 완성 코드 (0) | 2023.01.31 |

| 6. 자연어처리, 음성을 인식하자. (1) | 2023.01.31 |

| 5. Pose estimation 에서 스쿼트 자세를 측정하는 방법 (3) | 2023.01.31 |

| 4. 좌표로 접근을 해보자. (실험) (0) | 2023.01.16 |